La IA generativa se ha vuelto cotidiana, pero detrás hay un problema poco visible para la mayoría. Para crear imágenes, vídeo o escenas en 3D, hoy hacen falta muchas GPU que consumen energía y generan calor, sobre todo en centros de datos.

Un equipo de la Universidad Jiao Tong de Shanghái y la Universidad de Tsinghua dice haber probado otra vía, calcular con luz. Según el equipo, en algunas tareas la relación entre cálculo y consumo energético fue más de cien veces mejor que la de una GPU Nvidia A100. ¿Puede eso cambiar cómo se “alimenta” la IA en el futuro?

Qué es LightGen y quién lo ha desarrollado

LightGen se describe en un artículo publicado el 18 de diciembre de 2025 en la revista Science. El trabajo lo firman Yitong Chen junto a Xinyue Sun, Longtao Tan y otros investigadores de Jiao Tong y Tsinghua, y se centra en acelerar generación visual, no en crear un chip para todo tipo de programas.

La propia Jiao Tong lo presenta en un comunicado oficial como una plataforma de computación óptica para modelos generativos, no como un producto comercial listo para vender. En otras palabras, es una pieza de investigación pensada para demostrar que ciertas partes de la IA se pueden mover fuera de la electrónica tradicional.

Cómo calcula con luz y qué resultados reporta

La idea básica de la computación fotónica es reemplazar parte del “tráfico” eléctrico por fotones, que son paquetes de luz. En un chip clásico, mucha energía se pierde como calor cuando los electrones se mueven y chocan, algo que cualquiera ha notado en un portátil que se calienta. Con luz, la promesa es hacer operaciones en paralelo con menos disipación.

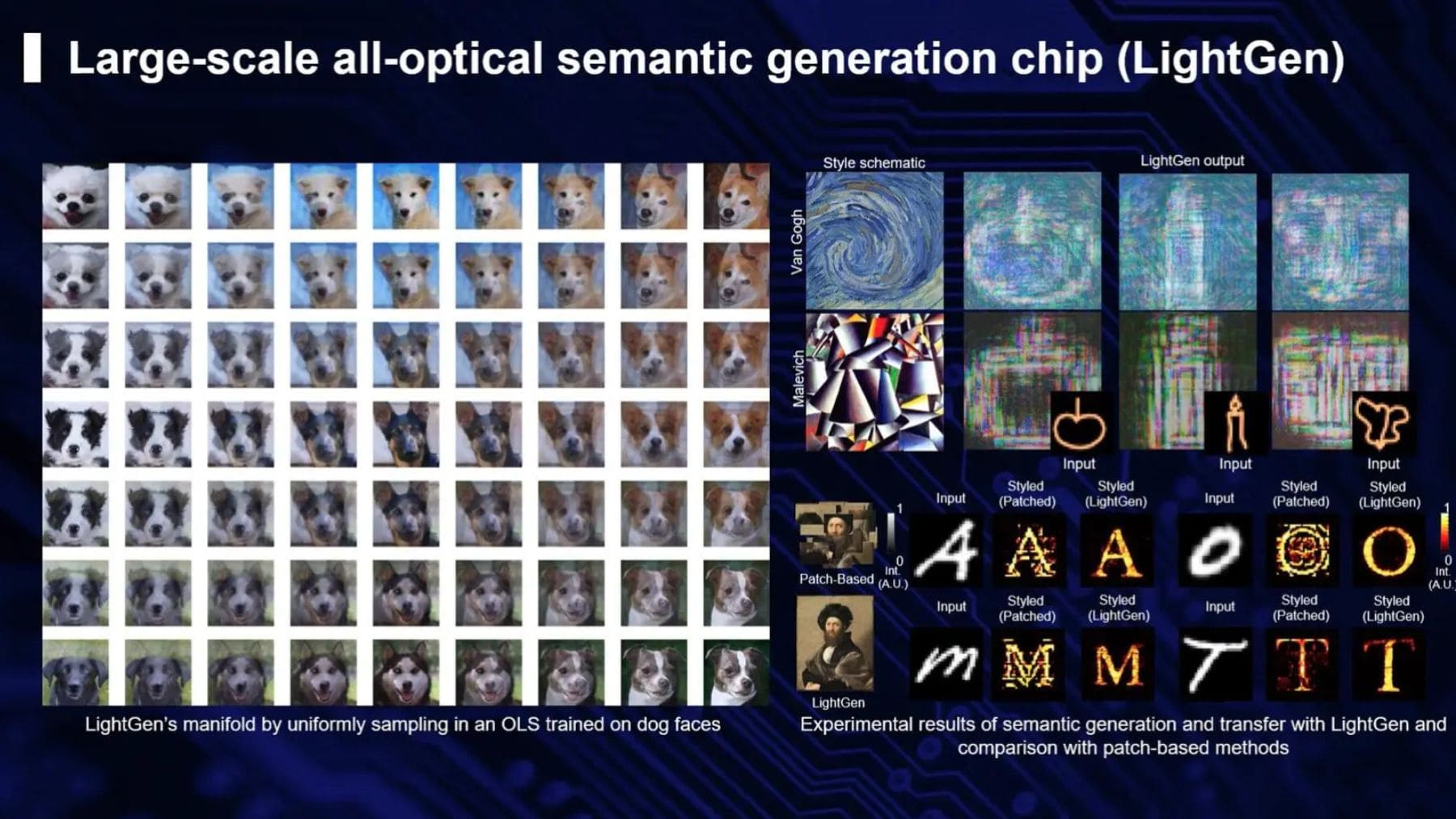

En una nota de prensa de la AAAS, la organización que edita Science, se explica que LightGen integra más de dos millones de “neuronas” fotónicas. También introduce lo que los autores llaman “espacio latente óptico”, una forma de trabajar con una versión comprimida de la información usando luz, y entrenar el sistema sin depender de respuestas correctas ya etiquetadas.

En sus pruebas, el equipo afirma que la mejora en velocidad y eficiencia energética supera dos órdenes de magnitud frente a chips electrónicos avanzados, medido de extremo a extremo. Y, según los propios datos reportados, en determinadas tareas esa ventaja sube a más de cien veces frente a una Nvidia A100. Chen lo resumió así «LightGen opens a new path for advancing generative AI with higher speed and efficiency».

Las limitaciones que frenan su llegada a los centros de datos

El estudio también marca límites claros. LightGen depende de láseres externos para generar y controlar la señal óptica, y su fabricación requiere procesos que no encajan todavía con la industria de semiconductores tal y como funciona hoy.

Integrarlo en un data center real obligaría a resolver coste, tamaño, fiabilidad y compatibilidad con el hardware existente. Por eso, incluso si la tecnología avanza, lo más probable es ver sistemas híbridos, con chips electrónicos para lo general y módulos ópticos para fases muy concretas donde la luz aporte una ventaja medible.

Una revisión de 2024 en Light Science & Applications recuerda que las redes neuronales ópticas avanzan rápido, pero siguen chocando con retos como la escalabilidad y la integración. LightGen encaja en esa carrera, con resultados llamativos, pero todavía lejos de un cambio inmediato.

El estudio principal se ha publicado en Science.