El 2 de abril de 2026, Google DeepMind anunció Gemma 4, una nueva familia de modelos de inteligencia artificial con «pesos abiertos» bajo licencia Apache 2.0. El comunicado lo firman Clement Farabet y Olivier Lacombe, y Google lo enmarca en una comunidad que dice haber descargado Gemma más de 400 millones de veces y haber creado más de 100.000 variantes, con ejemplos que citan a INSAIT y a la Universidad de Yale. La compañía asegura que Gemma 4 llega en cuatro tamaños y apunta a tareas como razonamiento y programación, además de procesar texto, imágenes y, en modelos pequeños, audio, con soporte de más de 140 idiomas y una ventana de contexto, la cantidad de texto que puede «tener en mente», que puede llegar a 256.000 tokens.

Esto no va solo de «tener otro chatbot», la apuesta es que parte de esa IA se ejecute cerca del usuario, en un móvil o un portátil, y que sirva para tareas largas y más complejas. ¿El resultado será más útil en clase y en el trabajo, o acabará en una lista de funciones que nadie usa? Ahí está la tensión.

Una IA con pesos abiertos

En la documentación oficial, Google explica que Gemma se distribuye con pesos abiertos y que permite «uso comercial responsable». También indica que se puede descargar desde plataformas como Kaggle y Hugging Face, algo clave si quieres probarlo fuera de un servicio cerrado.

Que los pesos sean abiertos significa, en la práctica, que puedes ejecutar el modelo en tu infraestructura y ajustarlo a tu caso. No implica que todo el proceso de entrenamiento esté publicado, pero sí abre la puerta a más control sobre privacidad, costes y personalización. Para muchas organizaciones, eso ya es mucho.

Del móvil al servidor

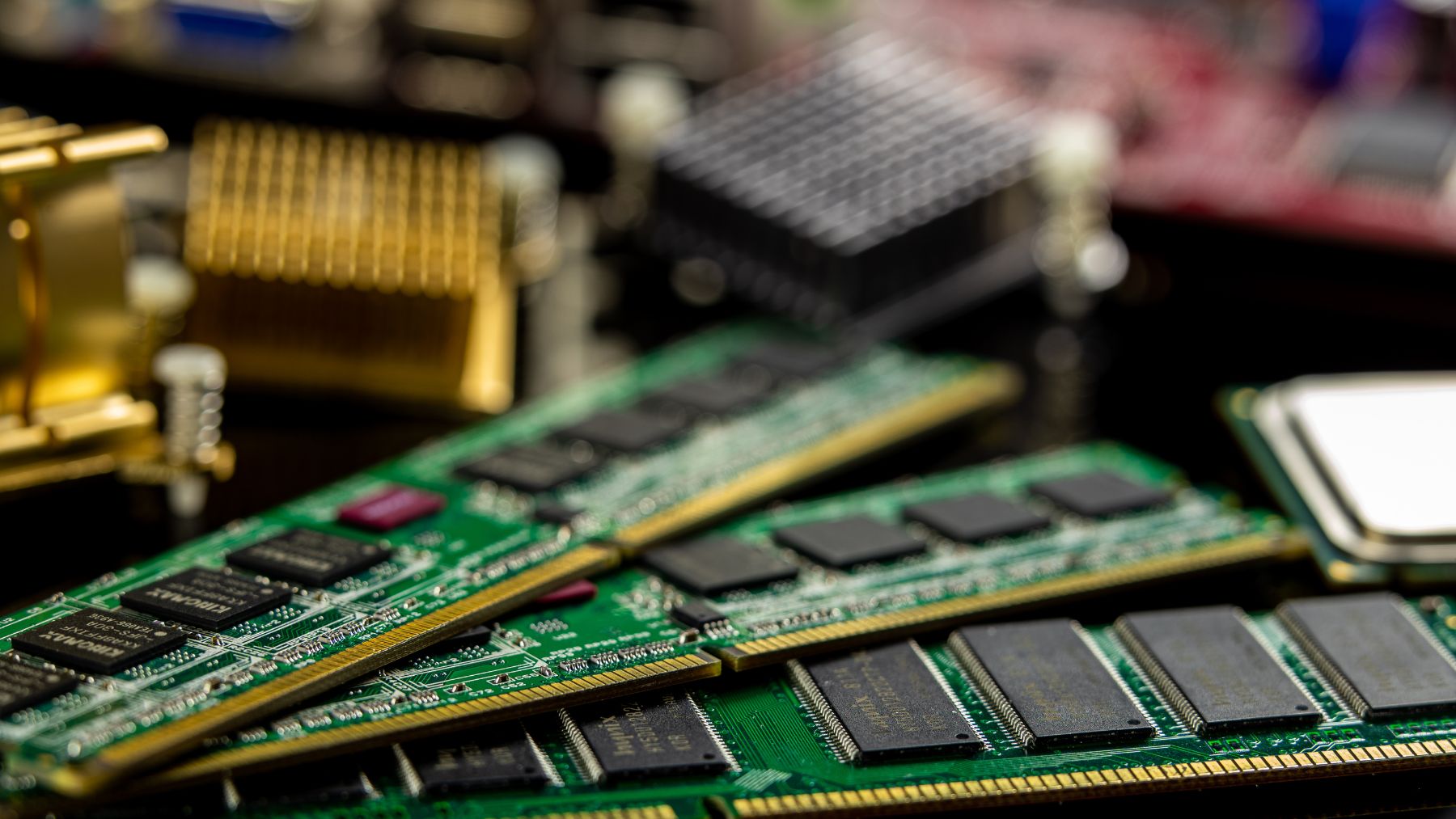

Google presenta Gemma 4 en dos escalones. Las versiones E2B y E4B se orientan a móviles y a lo que se suele llamar «borde», equipos que trabajan cerca del usuario sin mandar todo a la nube, y la propia compañía afirma que pueden funcionar «completely offline with near-zero latency» en dispositivos como teléfonos o placas tipo Raspberry Pi. Las variantes 26B y 31B suben la apuesta y se plantean como modelos para ordenadores personales potentes, pensados para razonamiento avanzado y para convertir una estación de trabajo en un servidor de IA más local.

Aquí aparece la jerga típica de la IA. «B» suele referirse a miles de millones de parámetros, que son los ajustes internos que el modelo usa para predecir la siguiente palabra. Cuantos más parámetros, más margen para tareas difíciles, pero también más coste en memoria y energía.

La estrategia en Android va por el carril de los modelos pequeños. En el anuncio de AICore Developer Preview, David Chou y Caren Chang explican que Gemma 4 será la base de la próxima generación de Gemini Nano y que, en móviles, se ofrece en dos tamaños, E4B y E2B, con soporte nativo para texto, imágenes y audio.

Texto, imágenes y audio sin complicarse

El enfoque de Gemma 4 es multimodal, un término simple para decir que no se limita a leer texto. En la ficha técnica, Google DeepMind señala que el modelo acepta texto e imágenes, y que el audio está disponible en los tamaños pequeños, con versiones ya preparadas para usar tal cual o afinadas para seguir instrucciones.

En la práctica, esto permite cosas muy concretas. Puedes pedirle que explique una foto, que resuma una captura de pantalla o que transforme una nota de voz en un borrador de correo. Cuando oigas «token», piensa en un trocito de texto, a veces una palabra y a veces una parte.

Eso sí, la salida suele ser texto, así que conviene no confundir «entender» con «ver como una persona». Si la imagen está borrosa o el audio tiene ruido, el modelo puede equivocarse y sonar convincente. Un clásico.

Agentes, código y despliegue comercial

Desde Google AI Edge lo describen como un salto hacia sistemas que pueden planificar varios pasos y actuar, no solo responder. En su nota hablan de ir «go beyond chatbots» y de construir agentes y casos de uso autónomos que corran directamente en el dispositivo.

Para empresas, la parte comercial suele girar alrededor de dónde quedan los datos. En Google Cloud señalan que Gemma 4 busca ejecutar lógica compleja manteniendo la información dentro de límites seguros, y que puede desplegarse en su infraestructura para cumplir requisitos de control y cumplimiento normativo.

Al final del día, todo dependerá del encaje. Habrá equipos que prefieran la nube por comodidad y otros que ganen al ejecutar la IA en local por privacidad o por velocidad. Lo relevante es que Gemma 4 intenta ofrecer ese abanico con un modelo más abierto y con tamaños que se adaptan a muchos escenarios.

La nota oficial se ha publicado en el blog de Google.