Copilot, el asistente de inteligencia artificial de Microsoft, ya no es una curiosidad para “probar un rato”. Está en Windows y se ofrece en servicios que muchas personas usan para estudiar, trabajar y organizarse.

Pero en sus propias condiciones de uso, Microsoft deja un aviso que corta el impulso. La compañía pide no confiar en Copilot para consejos importantes y recuerda que puede equivocarse, algo relevante justo cuando se vende como herramienta de productividad y hasta para temas de salud.

La frase en letra pequeña

En las Condiciones de uso de Microsoft Copilot para particulares, con fecha de aplicación 24 de octubre de 2025, aparece una frase que sorprende a primera vista. Microsoft escribe “Copilot es solo para fines de entretenimiento” y también “No confíes en Copilot para obtener consejos importantes”. El mismo texto añade que puede cometer errores, que algunas fuentes pueden no ser fiables y que una respuesta puede sonar convincente y aun así estar incompleta o equivocada.

Esto no significa que Copilot no sirva para nada. Significa que, si algo es importante, la última palabra no debe ser de un chatbot y conviene comprobarlo antes de actuar.

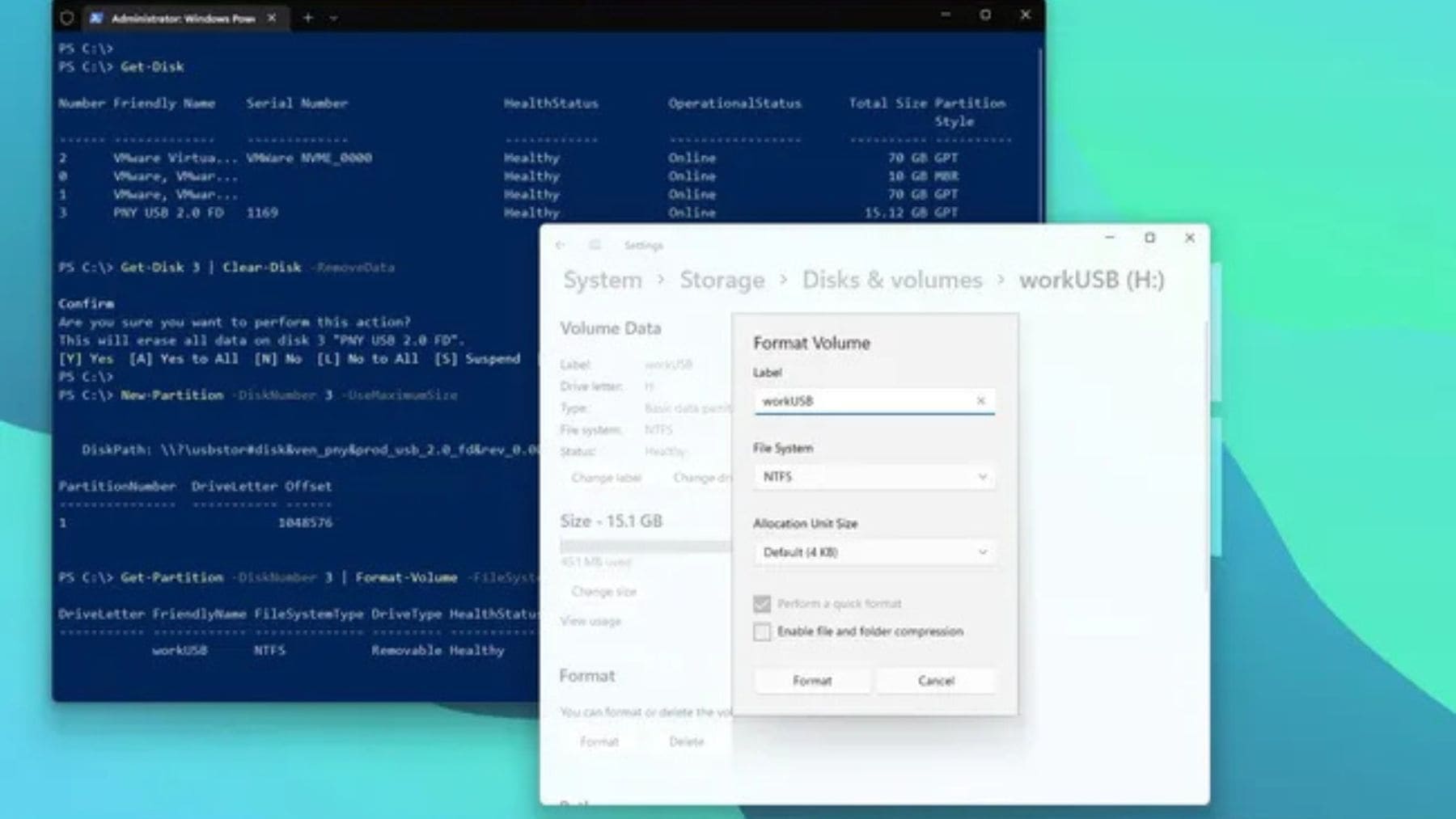

Copilot está en Windows

Este aviso importa porque Copilot está a mano. Microsoft ofrece “Copilot on Windows” como una app de escritorio y explica tres formas de abrirla, con el icono de la barra de tareas, con la tecla Copilot en algunos teclados o con la voz si se activa esa opción.

La compañía también empuja Copilot hacia el trabajo. En su web de Microsoft 365 Copilot lo define como “IA diseñada para el trabajo” y lo sitúa dentro de las aplicaciones de Microsoft que ya usan muchas empresas.

Por qué puede fallar

Copilot es IA generativa, un sistema que construye texto a partir de patrones aprendidos. No “mira” la realidad como lo haría una persona y puede mezclar hechos ciertos con detalles inventados o desfasados.

Este comportamiento se suele llamar alucinación. En la práctica significa que el chatbot puede dar una respuesta con tono seguro aunque el dato clave esté mal, como cuando alguien explica algo de memoria y se equivoca.

La Organización Mundial de la Salud pidió en mayo de 2023 cautela con herramientas de modelos de lenguaje en salud. El motivo es sencillo, pueden generar respuestas plausibles y aun así contener errores serios, y eso puede afectar a decisiones sensibles.

Qué dicen los estudios

En octubre de 2023, un estudio en JAMA Network Open analizó respuestas de un chatbot a preguntas médicas creadas por 33 médicos de 17 especialidades. El equipo, liderado por Rachel S. Goodman junto a J. Randall Patrinely y Cosby A. Stone Jr, concluyó que muchas respuestas eran bastante correctas, pero subrayó limitaciones y la necesidad de verificar.

En 2026, un trabajo en npj Digital Medicine dirigido por Rachel L. Draelos comparó varios chatbots públicos con preguntas de pacientes. Encontró que entre un 22% y un 43% de respuestas resultaban problemáticas según médicos evaluadores, y que las consideradas inseguras aparecían entre un 5% y un 13% según el sistema.

También en febrero de 2026, el Oxford Internet Institute y el Nuffield Department of Primary Care Health Sciences de la Universidad de Oxford publicaron resultados de un ensayo con casi 1.300 participantes. Andrew Bean, Luc Rocher, Adam Mahdi y Rebecca Payne describieron que las personas que usaron modelos de lenguaje no tomaron mejores decisiones que quienes usaron métodos tradicionales, y que a menudo recibían una mezcla de buenas y malas recomendaciones.

Productividad y salud

En marzo de 2026, Microsoft AI presentó Copilot Health como un espacio separado dentro de Copilot para ordenar datos de salud y preparar mejor la conversación con el médico. El anuncio, firmado por Bay Gross, Peter Hames, Chris Kelly, Dominic King y Harsha Nori, insiste en que no sustituye al profesional sanitario y que no está pensado para diagnosticar o tratar.

Ahí es donde el aviso de “no lo uses para consejos importantes” se vuelve más fácil de entender. Un chatbot puede ser útil para resumir, ordenar ideas y hacer listas, pero un error en salud, dinero o aspectos legales puede tener consecuencias reales.

Usarlo con cabeza

Copilot puede servir para arrancar un borrador, como quien pide un esquema para estudiar o una primera versión de un correo. Funciona mejor cuando se usa para ordenar información y no para cerrar una decisión.

Para temas sensibles, lo prudente es tratarlo como un primer borrador. Si hay salud, dinero o aspectos legales por medio, toca contrastar con fuentes oficiales y, cuando haga falta, con un profesional.

Y conviene hacerse una pregunta sencilla antes de seguir. ¿Le confiarías esa decisión a alguien que puede sonar convincente y aun así equivocarse sin darse cuenta? Mejor que el chatbot te ayude a pensar, no a decidir.

El documento oficial se ha publicado en las Condiciones de uso de Microsoft Copilot.