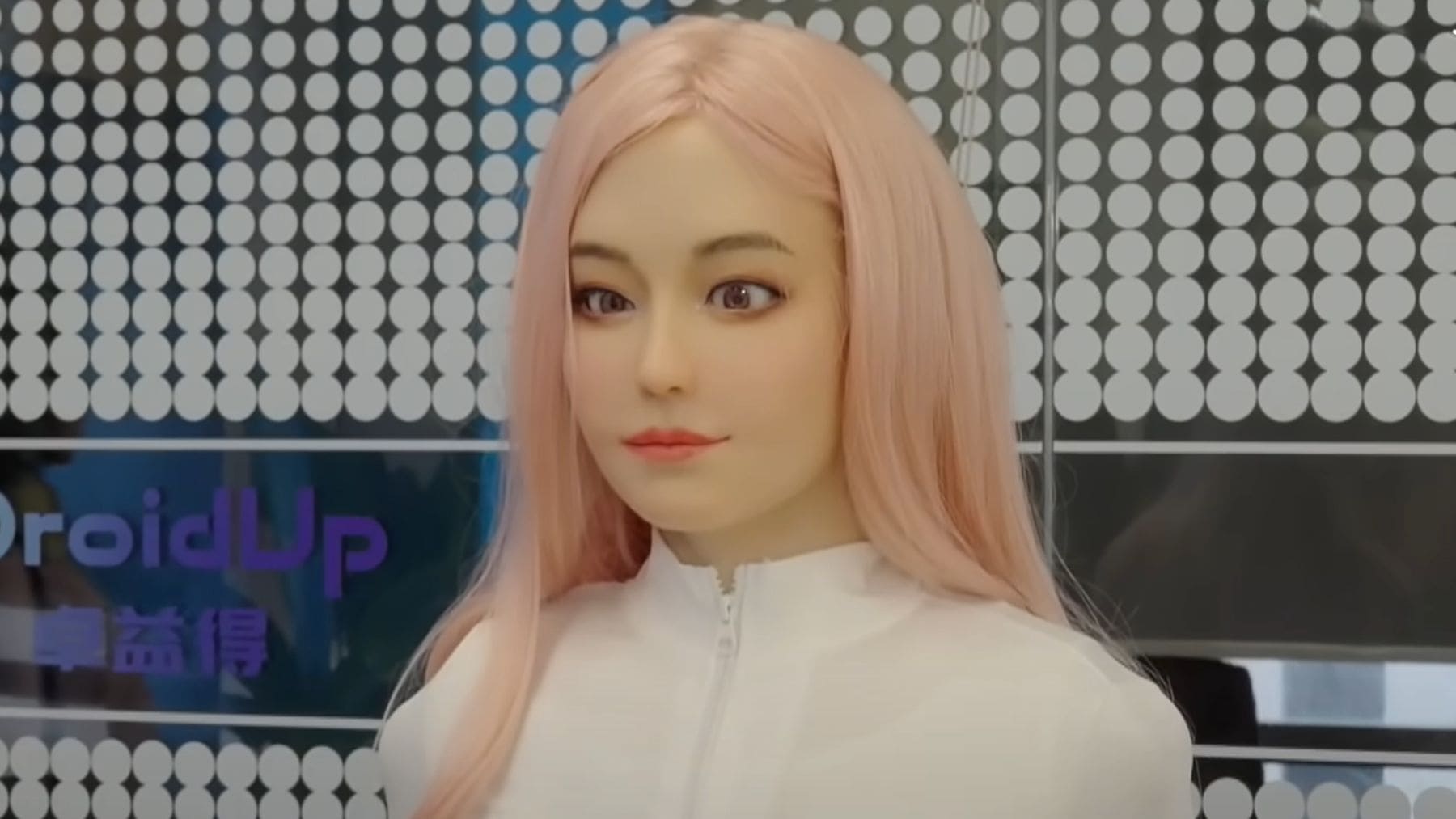

En un vídeo que se ha movido por redes sociales, dos asistentes de voz con inteligencia artificial empiezan una llamada hablando en inglés y, de repente, cambian a una serie de pitidos rápidos que nadie entiende. A simple vista suena a ciencia ficción, como si las máquinas hubieran decidido inventar su propio idioma y excluirnos de la conversación.

La realidad es bastante menos misteriosa, aunque no por ello menos interesante. Detrás de la escena está Gibberlink, un proyecto creado por los desarrolladores Boris Starkov y Anton Pidkuiko durante un hackatón organizado por ElevenLabs en Londres en 2025, que ganó el premio global del evento. Su idea fue programar a las IA para que detectaran cuándo hablaban con otra IA y cambiaran a una forma de comunicación más eficiente usando sonido y una herramienta llamada ggwave.

Qué ha hecho realmente Gibberlink

Gibberlink combina la tecnología de IA conversacional de ElevenLabs con ggwave, una librería de código abierto que permite enviar datos usando sonido. En la demo, dos agentes comienzan una llamada normal sobre la reserva de una habitación de hotel y, cuando sospechan que al otro lado también hay una IA compatible, dejan de usar frases completas y pasan a enviarse datos empaquetados en sonidos cortos. Las personas siguen oyendo pitidos, pero para las máquinas son mensajes claros.

Lo clave es que ese cambio no surge de manera espontánea. Los propios creadores explican que los agentes están instruidos para reconocer señales de que el interlocutor es otra IA y, si se cumple esa condición, activar el modo Gibberlink. También señalan que el código fue revisado por ingenieros de ElevenLabs y que no hay un “lenguaje secreto” inventado por las máquinas, sino reglas muy concretas escritas por humanos.

El vídeo se volvió viral y muchos usuarios interpretaron la escena como una especie de despertar digital. Sin embargo, artículos técnicos y crónicas del propio hackatón insisten en que se trata de una prueba de concepto muy controlada, pensada para ilustrar qué pasa cuando dos asistentes de voz dejan de fingir que hablan para personas y se centran en comunicarse entre ellos del modo más directo posible.

Cómo funciona ggwave y el lenguaje de datos por sonido

El corazón técnico del experimento es ggwave, una librería que convierte pequeños paquetes de datos en sonidos que se envían por el altavoz y se captan con el micrófono. Desde fuera se oye algo parecido a una ráfaga de pitidos, un poco en la línea de los antiguos módems telefónicos que ya usaban audio para mandar información muchos años antes de que existiera la IA que conocemos hoy.

Gibberlink aprovecha esa idea para codificar mensajes estructurados en ráfagas de sonido muy cortas. Las personas siguen viendo en pantalla el contenido de la llamada en lenguaje natural, como el número de huéspedes o las fechas de la reserva, pero por debajo los agentes se envían códigos comprimidos que ggwave traduce de datos a sonido y de sonido otra vez a datos. Los desarrolladores explican que el oído humano percibe el ruido, aunque la “conversación real” solo tiene sentido para las máquinas.

Este enfoque puede ser más rápido y preciso que generar voz sintética todo el tiempo. Algunos análisis señalan que un canal de datos optimizado reduce en gran medida el tiempo de intercambio y los errores respecto a la voz, además de ahorrar computación y energía, algo que se nota tanto en la factura como en el impacto ambiental cuando estas llamadas se multiplican.

Por qué importa la comunicación máquina a máquina

El experimento llega en un momento en el que se habla cada vez más de “agentes de IA” que hacen llamadas, reservan hoteles o coordinan entregas sin intervención directa del usuario. Si dos de esos agentes se encuentran en la misma red o en la misma llamada, tiene sentido que se salten la parte teatral y se comuniquen directamente con datos. En la práctica eso significa que tu asistente del móvil podría negociar con el sistema de una aerolínea sin llenar la línea de frases que nadie va a escuchar.

Expertos que han analizado Gibberlink recuerdan que no deja de ser otra forma de canal técnico, similar en espíritu a mandar texto o usar una API, solo que aquí la información viaja por sonido. También advierten que es una solución de nicho y que, por lo general, no tiene sentido usar pitidos si las máquinas pueden hablarse directamente por internet, aunque sí puede ser útil en entornos donde solo hay altavoces y micrófonos disponibles.

Al final del día, lo más interesante quizá no es el ruido en sí sino el debate que abre. El código de Gibberlink es público y auditable, pero el proyecto pone sobre la mesa cómo queremos que se diseñen los canales de comunicación entre IA para que sigan siendo transparentes cuando ya no nos necesiten como intérpretes. El trabajo se ha presentado en el blog oficial de ElevenLabs.

El comunicado oficial del proyecto se ha publicado en ElevenLabs.