¿Te imaginas perder la voz de un día para otro? No poder pedir agua, mandar una nota de voz o decir «te quiero» sin ayuda. En Estados Unidos, un paciente con esclerosis lateral amiotrófica (ELA) ha logrado comunicarse otra vez gracias a un implante cerebral y un sistema de inteligencia artificial.

El trabajo se probó con Casey Harrell dentro del ensayo clínico BrainGate2 y se presentó en un estudio publicado el 14 de agosto de 2024 en The New England Journal of Medicine. No es magia, pero sí un cambio práctico en una vida real.

Qué significa «leer la mente» aquí

La frase «leer la mente» suena a ciencia ficción. En realidad, la IA no adivina pensamientos sueltos ni secretos. Lo que interpreta son señales de una zona del cerebro que intenta mandar órdenes a los músculos del habla, como la lengua y los labios.

En este tipo de interfaz cerebro-ordenador, un puente entre el cerebro y una máquina, unos electrodos recogen actividad eléctrica y un modelo de IA aprende a asociarla con palabras. No se trata de telepatía, sino de traducción de patrones. En la práctica, el usuario intenta decir una frase y el sistema la convierte en texto y después en voz.

Un implante para volver a hablar con los suyos

Harrell tenía 45 años y su ELA había hecho su habla casi incomprensible. En el día a día, necesitaba que otras personas «interpretaran» lo que estaba intentando decir. Es el tipo de situación que aisla, aunque la mente siga funcionando con normalidad.

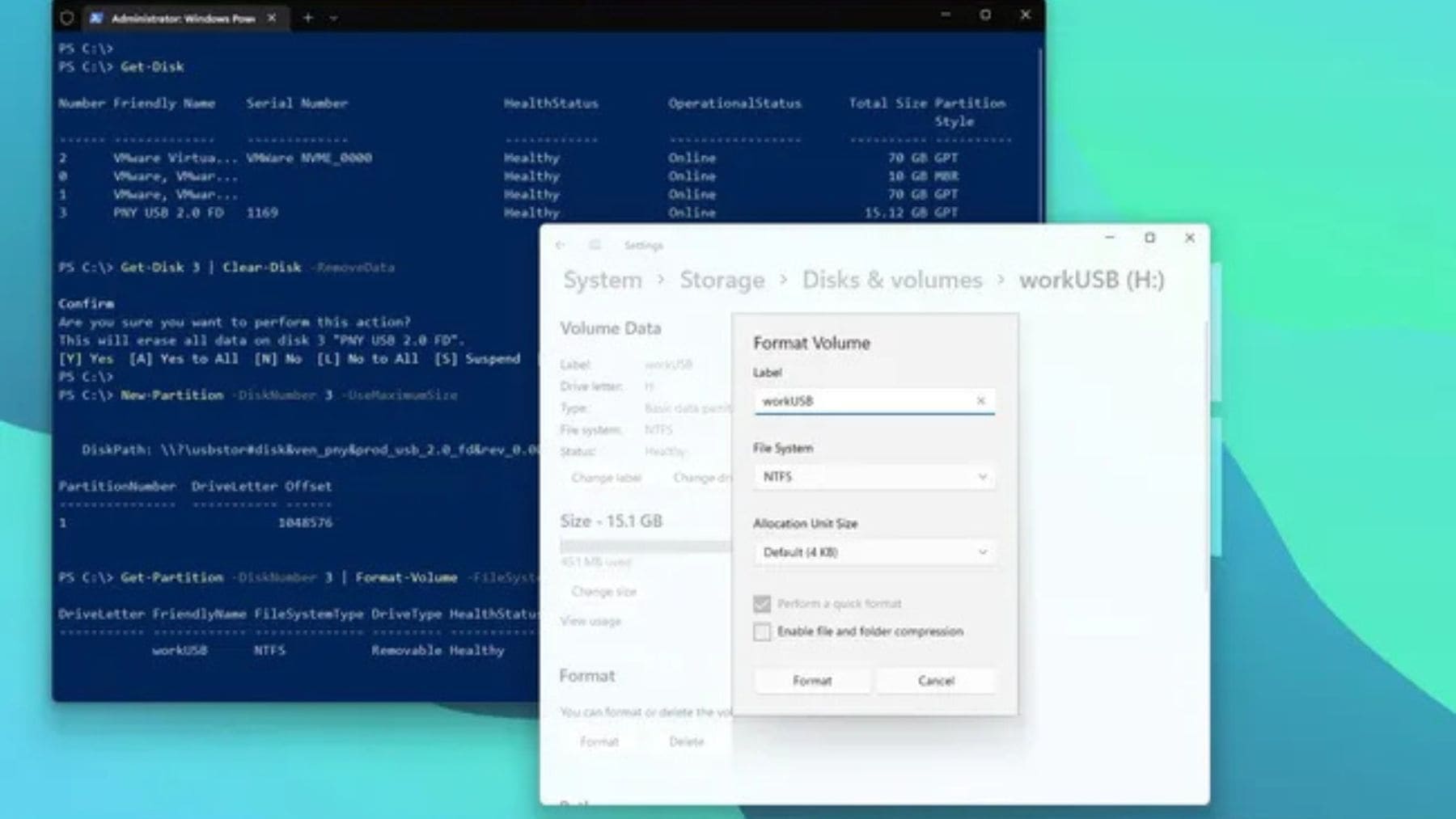

En julio de 2023, el neurocirujano David Brandman, de UC Davis Health, implantó cuatro matrices de microelectrodos en una zona del hemisferio izquierdo relacionada con el control del habla. El sistema registraba señales de 256 puntos, y el neurocientífico Sergey Stavisky lideró el trabajo de decodificación en el UC Davis Neuroprosthetics Lab.

Brandman lo explicó sin adornos. «Ayudó a comunicarse con amigos, familia y cuidadores», dijo al presentar el sistema en el comunicado oficial de la universidad. El autor principal Nicholas Card también subrayó que ver ese cambio en una familia es parte del valor de estos ensayos.

De deletrear para sobrevivir a conversar de verdad

Muchas ayudas actuales para la parálisis son útiles, pero lentas. Elegir letras una a una se parece más a rellenar un formulario que a hablar con naturalidad. Y cuando el cansancio aprieta, cada palabra cuesta.

En el estudio de UC Davis, la decodificación se hacía en tiempo real y el equipo reportó una precisión de alrededor del 97 por ciento en sesiones repetidas durante meses. Harrell lo resumió con una frase dura y fácil de entender. «Es como estar atrapado», dijo sobre no poder comunicarse.

Este caso no está solo. En 2023, un equipo liderado por Krishna Shenoy y Jaimie Henderson mostró en Nature una interfaz capaz de convertir intentos de habla en texto a decenas de palabras por minuto, acercándose a una conversación normal. Los autores avisaron de que todavía no es un sistema listo para la calle, pero marcó un listón nuevo.

Cuando la voz vuelve, aunque sea digital

No es lo mismo ver palabras en una pantalla que escucharlas. En la nota de UC Davis, el equipo cuenta que el texto se puede leer en voz alta con un sintetizador entrenado con grabaciones previas del propio paciente, para que el timbre se parezca al de antes de la enfermedad. Ese detalle importa más de lo que parece.

La misma idea también está avanzando en otros laboratorios, con el objetivo de reducir el retraso entre «intentar hablar» y oír sonido. En abril de 2025, investigadores de UC Berkeley y UC San Francisco, con Gopala Anumanchipalli y el neurocirujano Edward Chang como responsables, presentaron un método de voz en «streaming» casi en tiempo real, según un comunicado del sistema universitario de California.

Y hay enfoques que apuntan a vocabularios más pequeños pero con síntesis de palabras audibles usando electrodos sobre la superficie del cerebro. Un ejemplo es un estudio publicado en abril de 2024 en Scientific Reports que describe síntesis de palabras inteligibles en un participante con ELA. Paso a paso, la tecnología se está moviendo del laboratorio a la vida diaria.

Lo que falta y por qué el mundo acelera

Estos avances no son un dispositivo de consumo. Requieren cirugía, seguimiento y mucha validación. Además, un buen resultado en una persona no garantiza lo mismo en otras, así que los investigadores insisten en ampliar pruebas y medir estabilidad a largo plazo.

El ritmo también depende de reguladores y de inversión. En marzo de 2026, la Universidad de Fudan informó de que la Administración Nacional de Productos Médicos de China aprobó el uso comercial de un implante de interfaz cerebro-ordenador para recuperar movimientos de la mano en personas con lesiones medulares. No es un sistema de voz, pero muestra que algunos países ya están cruzando la frontera entre ensayo y clínica.

En Estados Unidos, los sistemas para comunicación en ELA siguen ligados a ensayos como BrainGate. Al final del día, la promesa es simple y enorme. Que alguien pueda volver a hablar con los suyos, sin deletrear su vida letra a letra.

El estudio principal se ha publicado en The New England Journal of Medicine.