¿Cobrar por recoger la cocina? En Los Ángeles ya ocurre. Algunas personas se colocan una diadema con el móvil y convierten su rutina en datos para entrenar sistemas de IA que deben moverse como humanos. No hace falta actuar ni entrar en un plató. Basta con cocinar, limpiar o regar una planta mientras la cámara lo ve todo.

La idea parece rara, pero apunta a algo más grande. Cuanto más avanzan los robots, más necesitan ver cómo actuamos en casas reales y no solo en laboratorios, y por eso esta microeconomía de vídeos en primera persona empieza a pagar por gestos tan comunes como abrir un armario, fregar una taza o cambiar de tarea sobre la marcha.

Así funciona este trabajo doméstico para la IA

Un reportaje publicado el 12 de marzo de 2026 explicó que algunos encargos pagan 80 dólares por unas dos horas de grabación. La escena es muy simple, recoger la diadema, volver a casa y grabarse haciendo tareas cotidianas como limpiar la cocina, lavar platos o regar plantas.

Azzam Ahmed y su esposa Samra, que viven en Pasadena y trabajan como mecánico y empleada de manicura, llegaron a ganar 1.200 dólares cada uno grabando cenas, limpieza y ratos de ocio. Ahmed lo resumió con una frase muy gráfica, “es como cobrar por respirar”.

Detrás de esa imagen casi cómica hay un negocio bastante serio. En su web oficial, Instawork presenta este servicio como una forma de captar datos humanos reales para acelerar el desarrollo y el despliegue de robots a gran escala.

Qué es la IA física y por qué necesita nuestros gestos

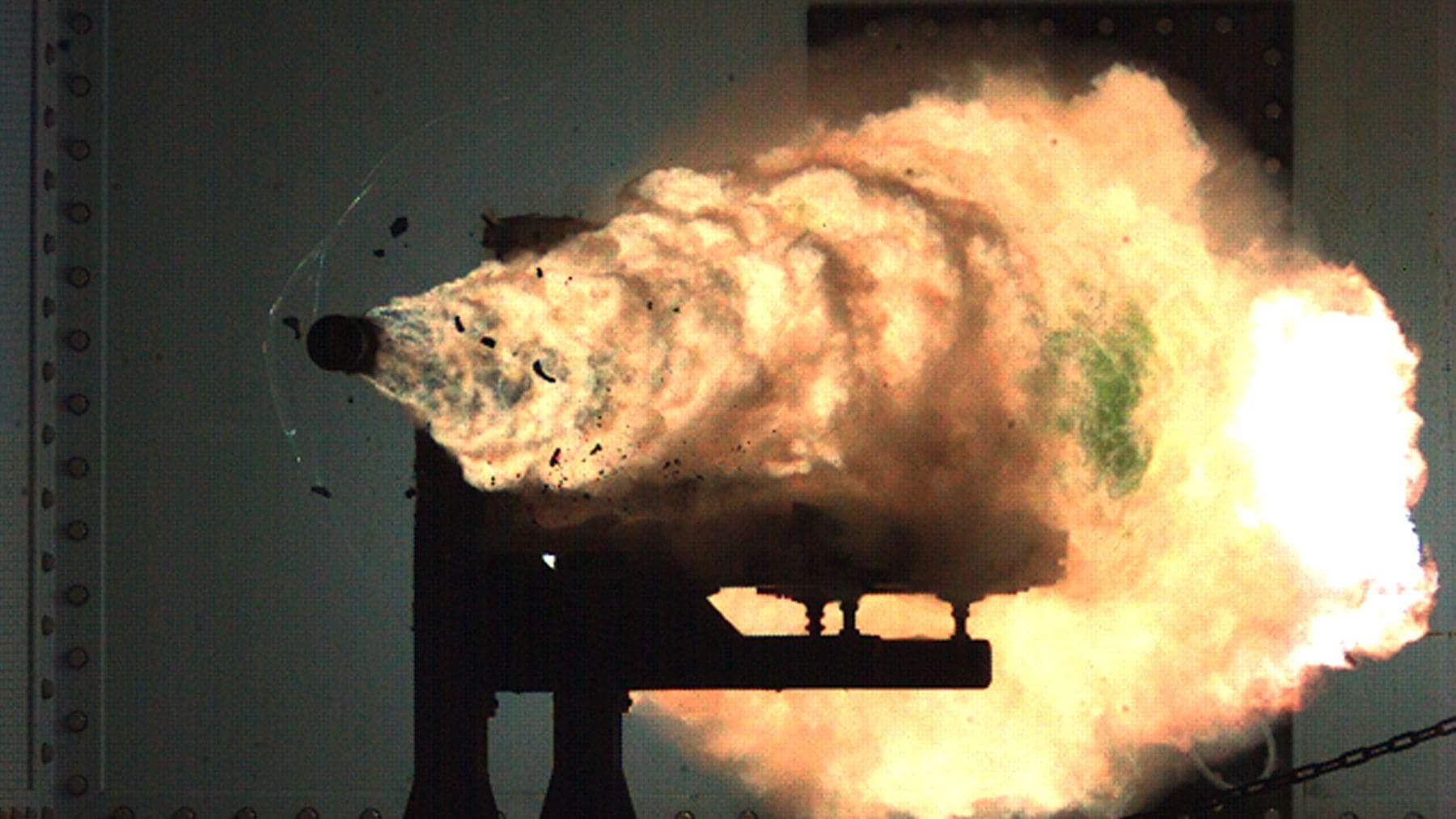

La llamada IA física no es el típico chatbot que responde preguntas. Es la que debe entender un espacio, planear movimientos y manipular objetos sin romperlos, algo que Google DeepMind resume como la capacidad de percibir, razonar, usar herramientas e interactuar con personas en el mundo real.

Shahbaz Magsi, cofundador de Sunain, pone un ejemplo muy cotidiano. Si una persona oye un grifo abierto mientras cocina, pausa una tarea y atiende la otra. Jason Saltzman, de CB Insights, resume la idea diciendo que los humanos siguen aportando la “verdad de terreno”, o dicho más fácil, ejemplos reales y correcciones ordenadas que los modelos todavía no saben producir por sí solos.

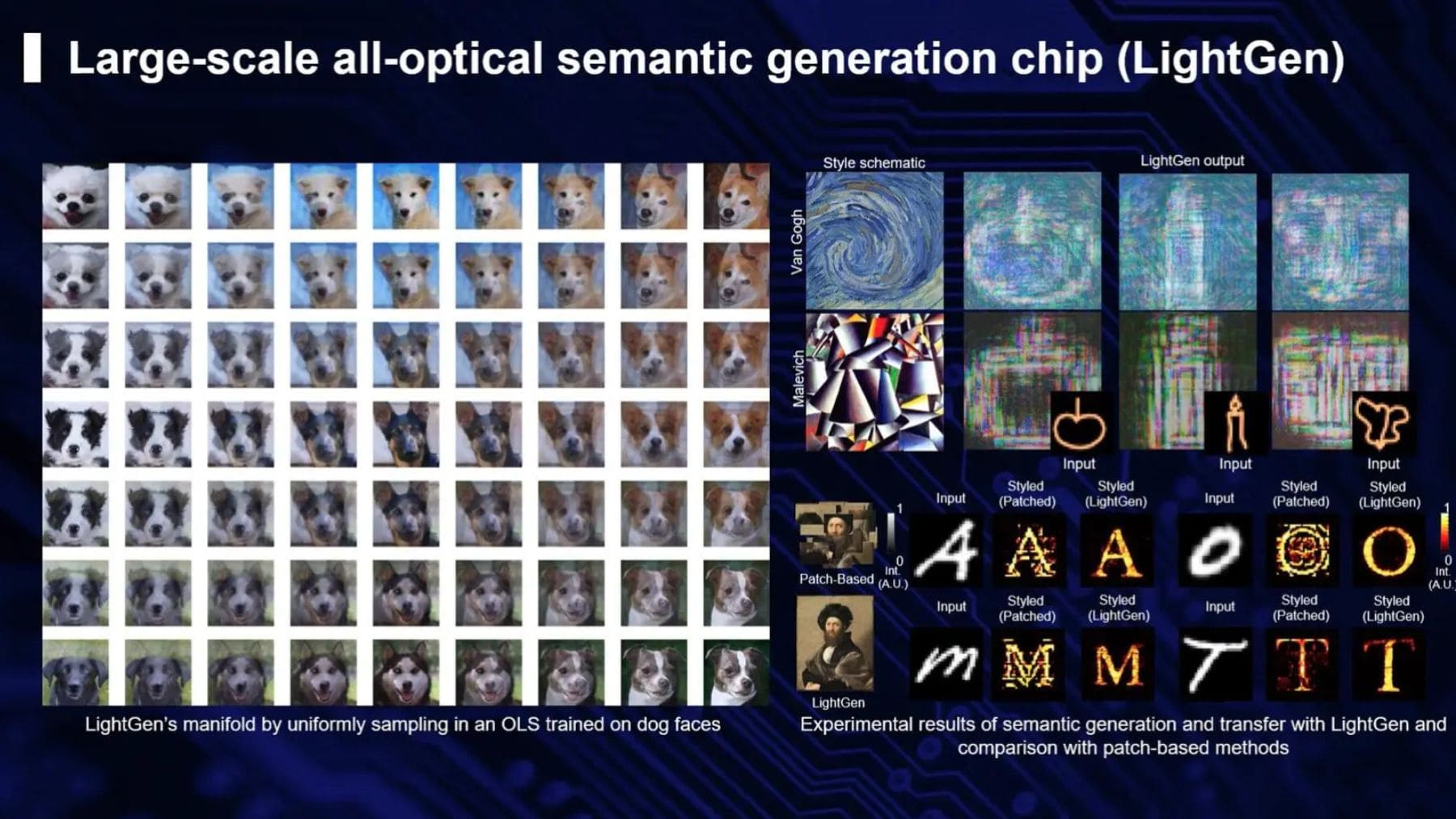

También hay investigación detrás. Bowen Yang y Zishuo Li, junto a equipos de Ant Group, la Academia China de Ciencias, la Universidad de Zhejiang, la Universidad de Pekín y la Academia de Inteligencia Artificial de Pekín, presentaron en febrero de 2026 un trabajo sobre vídeo en primera persona con móviles colgados al pecho para recoger datos a bajo coste y de forma continua, y concluyeron que ese material mejora el rendimiento de los modelos en tareas robóticas reales.

Un mercado que crece, pero no sin preguntas

La analista Jacqueline Du, de Goldman Sachs, calcula que el mercado mundial de robots humanoides podría alcanzar 38.000 millones de dólares en 2035. Tesla, Figure y Google DeepMind llevan tiempo dejando claro en sus páginas públicas que quieren máquinas capaces de trabajar en fábricas, casas y otros entornos cotidianos.

La carrera ya no es solo californiana. Rest of World documentó en enero de 2026 que en China se habían anunciado más de 40 centros estatales para recoger datos de entrenamiento robótico, mientras en Los Ángeles algunos trabajadores ya se quejan de la incomodidad del equipo, de clips rechazados y de una duda que sigue ahí, si este dinero rápido está ayudando a crear máquinas que luego puedan sustituir parte del trabajo humano.

El reportaje principal se ha publicado en Los Angeles Times.