Un trimestre de récord no siempre salva una acción. Micron publicó el 18 de marzo de 2026 unos resultados históricos, pero el mercado respondió con ventas y el título llegó a bajar cerca de un 30% desde el máximo de ese mismo día. ¿Qué ha cambiado?

El castigo mezcla dos miedos que han coincidido casi sin aviso. Micron ha elevado su plan de inversión para 2026 por encima de 25.000 millones de dólares y eso revive el fantasma de la sobreoferta en un negocio muy cíclico. También ha pesado TurboQuant, la nueva técnica de compresión de Google Research para que los modelos de IA usen mucha menos memoria al responder.

Un récord que no convence

En su nota oficial de resultados del segundo trimestre fiscal de 2026, Micron reportó 23.860 millones de dólares de ingresos, un margen bruto ajustado del 74,9% y 12,20 dólares de beneficio por acción en medidas non-GAAP. Sanjay Mehrotra, presidente y consejero delegado, lo resumió así, «In the AI era, memory has become a strategic asset for our customers».

La cifra que más ruido hizo no fue un ingreso, sino una decisión. En su presentación para inversores, Micron proyectó un gasto de capital, la inversión en fábricas y maquinaria, en 2026 por encima de 25.000 millones, impulsado sobre todo por obras de salas blancas, instalaciones ultralimpias donde se fabrican chips.

En un mercado donde el exceso de capacidad suele acabar en guerras de precios, esa línea puede pesar más que un trimestre brillante. A veces el inversor no compra el pasado, compra el miedo a que la fiesta se acabe.

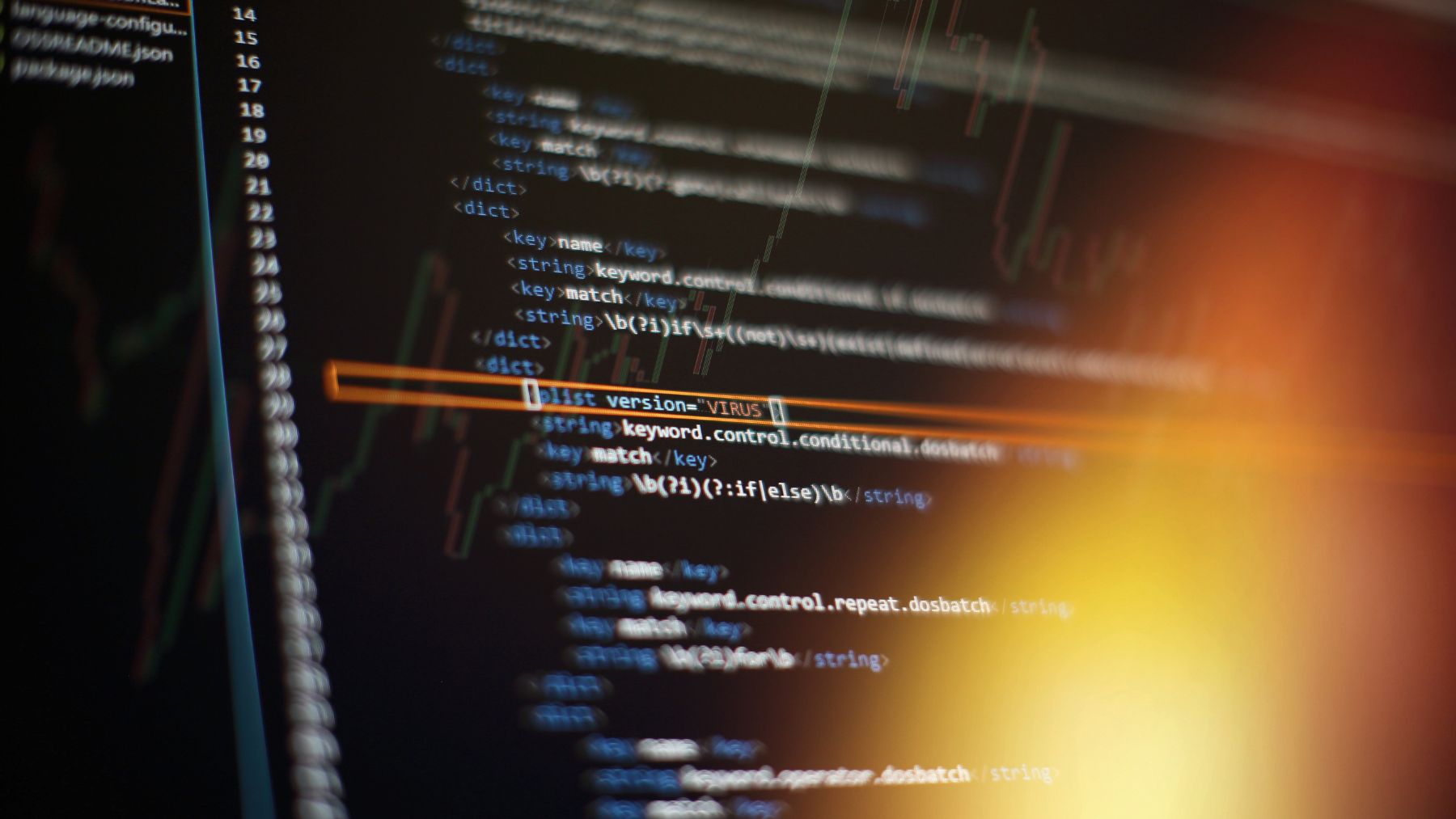

Qué hace TurboQuant

Aquí entra TurboQuant. Cuando un modelo de lenguaje responde, guarda una «memoria de trabajo» con lo que ya ha leído en el chat para no empezar de cero en cada palabra, algo parecido a tomar apuntes rápidos mientras estudias. Si la conversación se alarga, esos apuntes crecen y consumen mucha memoria.

TurboQuant, presentado el 24 de marzo por Amir Zandieh y Vahab Mirrokni en Google Research, propone comprimir esa memoria de trabajo de forma extrema. Según el propio equipo, el sistema puede reducir su tamaño en un factor de al menos seis y, en pruebas concretas, llega a cuantizarla hasta 3 bits sin reentrenar el modelo.

Por qué el mercado mira también a OpenAI

El detalle clave es dónde impacta la compresión. TurboQuant apunta sobre todo a la fase de inferencia, cuando el modelo ya entrenado está en producción y responde a usuarios reales. Es justo ahí donde el coste por respuesta manda.

Y no es una batalla solo de Google. OpenAI también ha insistido en exprimir más cada servidor y, en su anuncio de gpt-oss, señala que usa «grouped multi-query attention» para mejorar la eficiencia de inferencia y memoria, con menos datos que guardar por cada paso de la respuesta.

Aun así, la historia no es tan lineal. Si responder cuesta menos, muchas empresas pueden permitirse ofrecer más IA, y eso vuelve a empujar el consumo de hardware por otra vía. Es el típico efecto rebote.

La RAM empieza a aflojar

La bolsa va por delante, pero el mercado mira al termómetro de los precios. En el canal al contado, DRAMeXchange mostró el 6 de abril de 2026 una bajada semanal de alrededor del 8% en el precio medio de un módulo DDR5 de 16 GB para PC.

TrendForce, que sigue la industria de cerca, también describió una corrección en el mercado minorista de kits DDR5 en varias regiones, mientras las compras del consumidor se enfriaban. A la vez, citó a actores del sector que hablan de contratos más estables con grandes clientes, algo que suele amortiguar los cambios bruscos.

Para un usuario normal, el resumen es fácil. Si esta corrección se mantiene, es más probable que veas descuentos en RAM para ordenador antes de notar cambios en el hardware de IA que compran las nubes. También puede ser algo puntual.

Qué vigilar en los próximos meses

La primera pregunta es si Micron consigue invertir a ese ritmo sin que el mercado termine inundado de chips. La compañía defiende que amplía capacidad para atender demanda y que parte del gasto va a infraestructura que tarda años en traducirse en producción.

La segunda pregunta es cuánto se adopta TurboQuant fuera de la teoría. Si los grandes proveedores lo incorporan de forma masiva, la presión de memoria por conversación puede bajar, y eso cambia las previsiones que justifican el boom de la RAM.

Al final del día, lo que se está jugando es una carrera rara, el software encuentra atajos en semanas y el hardware se construye en años. Y en esa fricción, por ahora, Micron está pagando el precio.

El estudio principal se ha publicado en Google Research.