Estados Unidos despliega un portaaviones de propulsión nuclear de 97.000 toneladas que se dirige a Sudamérica

El portaaviones nuclear USS Nimitz, el más veterano en servicio activo de la Marina de Estados Unidos, ha salido de Naval Base Kitsap-Bremerton, en…..

Mientras la IA no para de eliminar puestos de trabajos, esta profesión cada vez tiene más demanda: sueldos de 75.000 dólares e incorporación inmediata

Pokémon celebra su 30 aniversario con ‘Pokémon Champions’, el nuevo juego gratuito para Nintendo Switch

Reino Unido acelera su arma láser naval: con cargador infinito para derribar drones sin límite de munición

Giro inaudito en España: la Armada va a construir un portaaviones inspirado en el Charles De Gaulle con capacidad para 30 aviones

WhatsApp va a dejar de funcionar en 15 millones de móviles muy pronto: la lista de los dispositivos afectados

Los nacidos entre 1981 y 2009 tendrán que pedir permiso al Ejército para salir del país: el Gobierno de Alemania lo hace oficial

«No confíe en Copilot»: Microsoft manda un aviso a los usuarios sobre su IA y es importante

Tus vecinos se podrían estar conectando a tu WiFi pero hay una forma de saberlo y lo más importante, impedirlo

Nueva filtración sobre la PS6: se descubre lo que Sony no quiere que sepan sus competidores y en Xbox ya están temblando

Actualidad

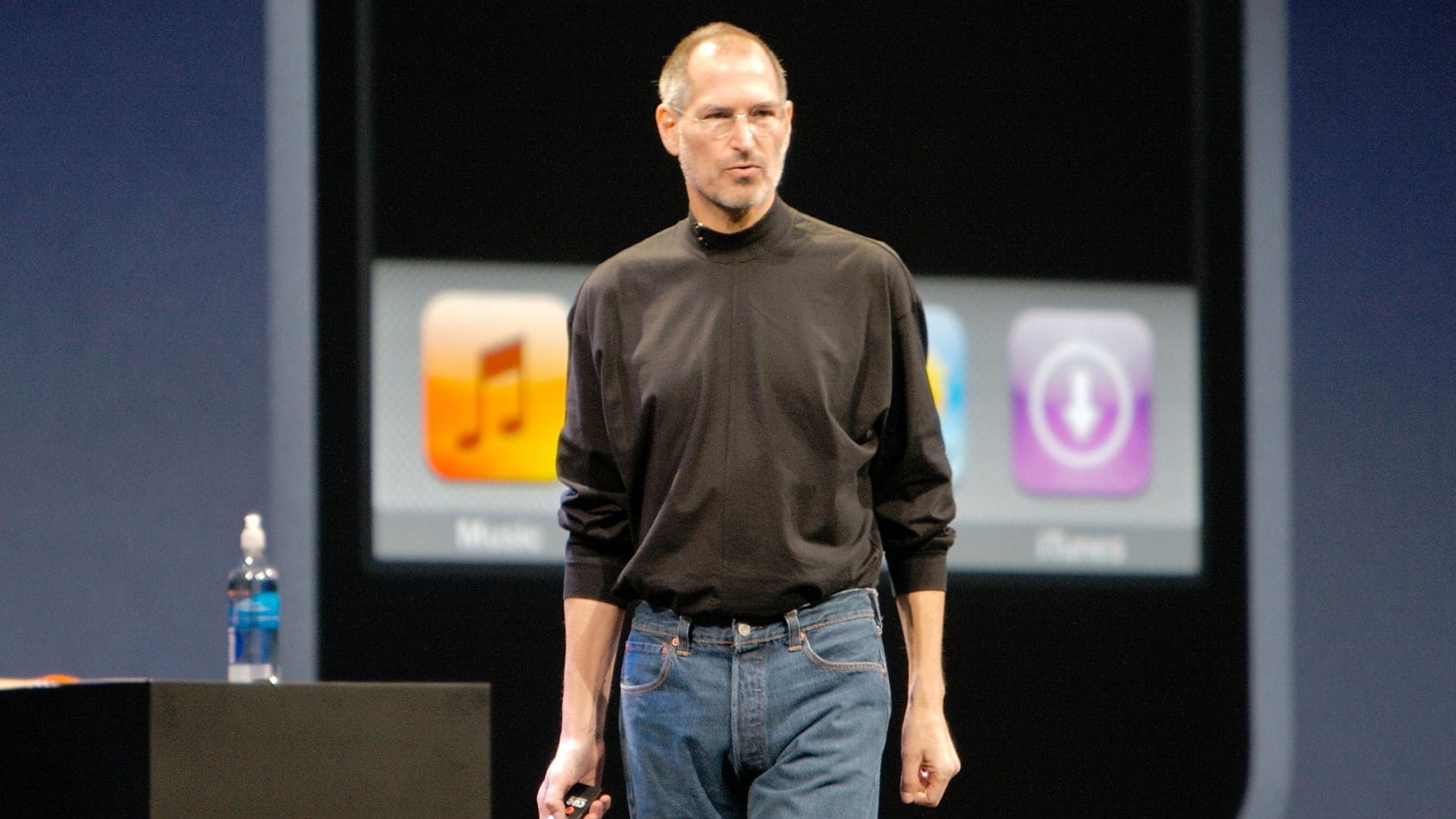

La reflexión de Steve Jobs que inspira y hace reflexionar: «Mis cosas favoritas de la vida no cuestan dinero. Está claro que el recurso más precioso que todos tenemos es el tiempo»

Steve Jobs, cofundador de Apple y una de las caras más visibles detrás del iPhone,…..

Hace 17 años se mudó de casa y lo que acaba de encontrar confirma que el antiguo dueño vivía en el futuro: «No teníamos ni idea de que existiera»

Hay cosas que no esperas encontrar al revisar el cableado de casa. A principios de…..

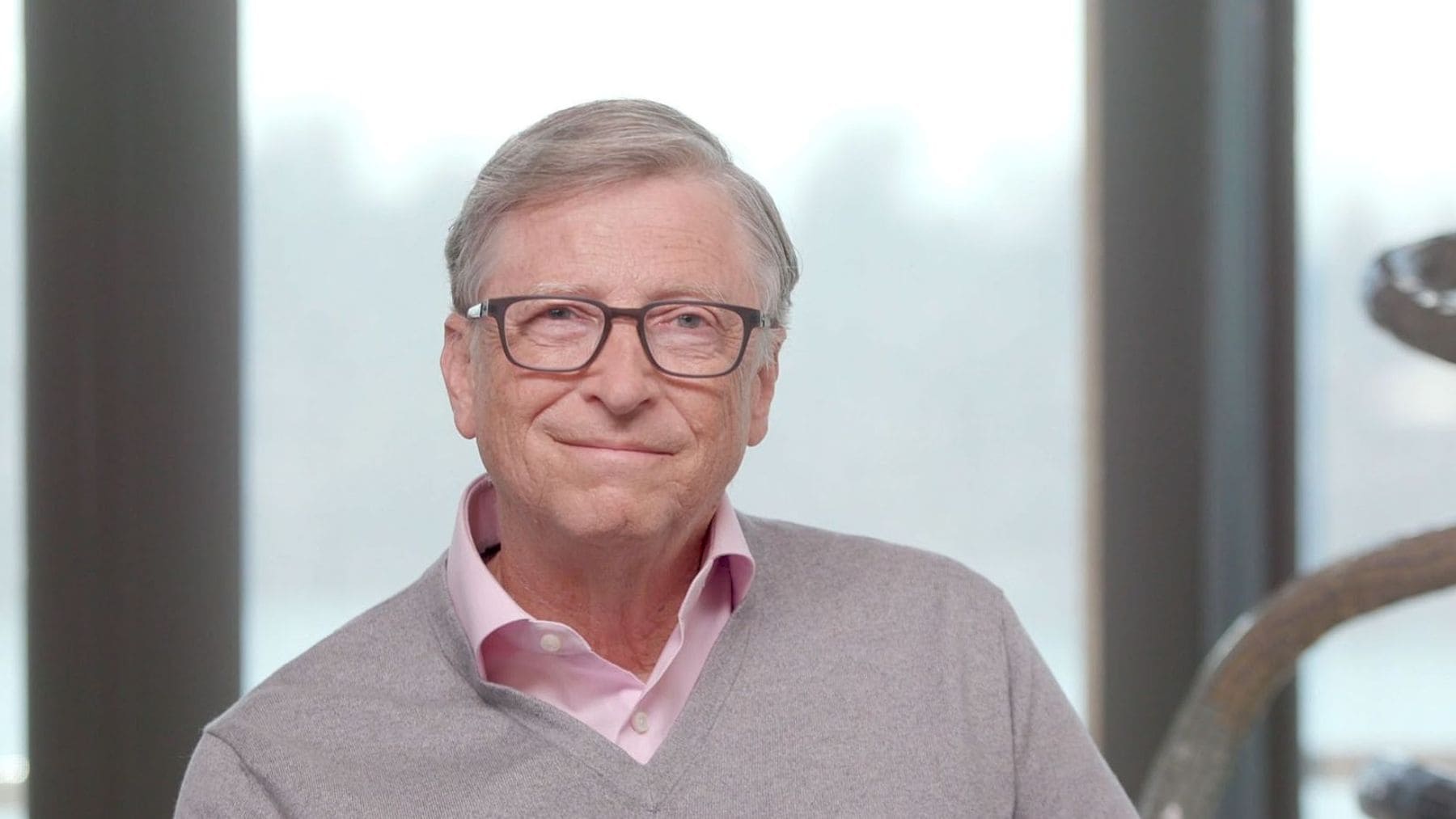

La reflexión de Bill Gates que cambia la forma en la que ves el mundo: «El mundo esperará que logres algo, independientemente de que te sientas bien o no contigo mismo»

¿Puede una frase resumir décadas de trabajo? En el caso de Bill Gates, a veces…..

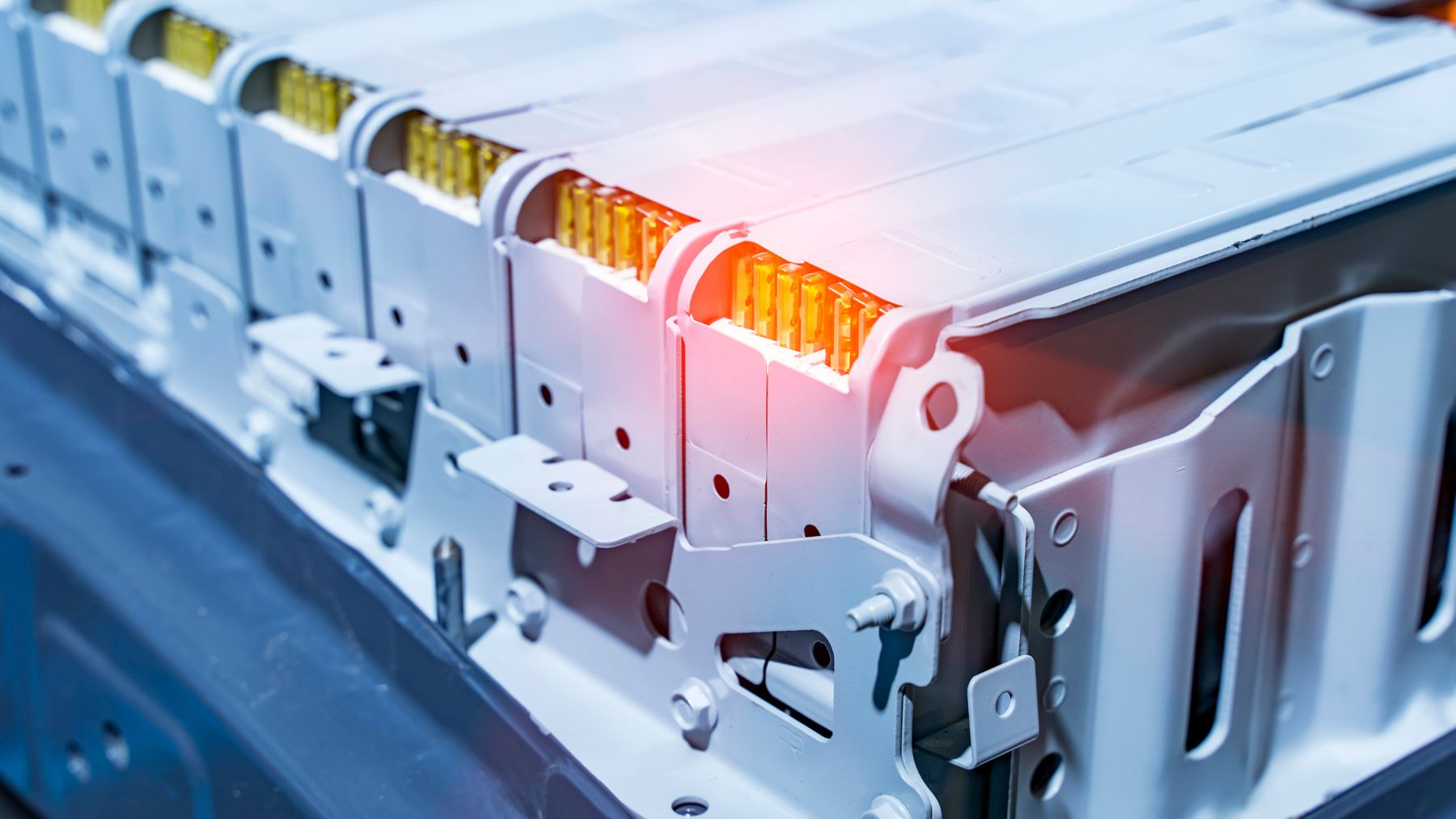

Hallazgo que transforma las baterías para siempre: crean una tecnología de litio-aire capaz de almacenar 10 veces más energía que las tradicionales

Cargar el móvil cada noche se ha vuelto casi automático. Pero, ¿y si una batería…..

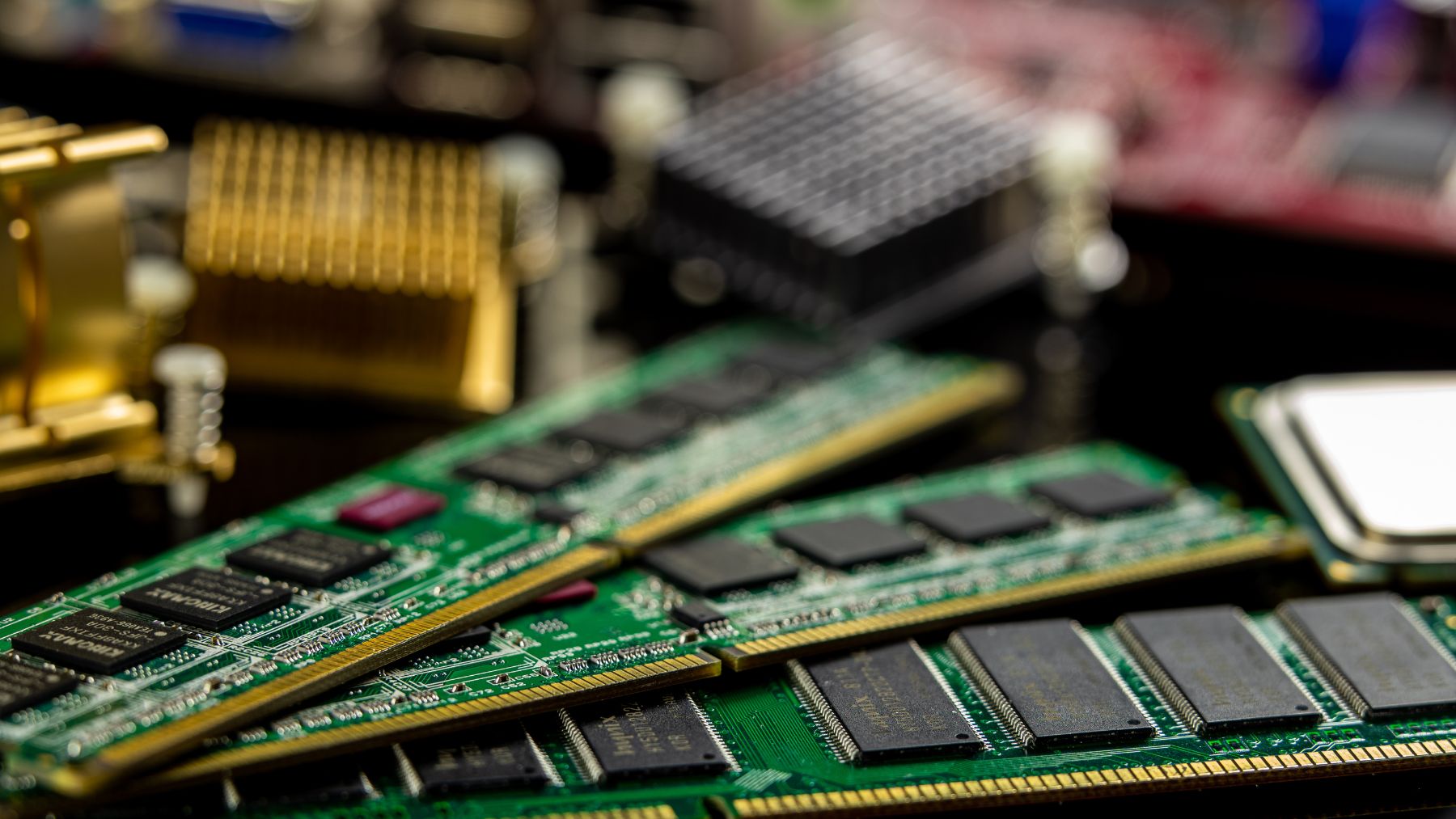

Parece un sueño pero las memorias RAM están bajando de precio y se lo debemos todo a Google y OpenAI

Un trimestre de récord no siempre salva una acción. Micron publicó el 18 de marzo…..

El fin de las baterías de litio es real: BAIC está fabricando baterías de sodio que se cargan al 100% en sólo 11 minutos

¿Y si “cargar” dejara de ser la parte aburrida del coche eléctrico? El grupo chino…..

Ciberseguridad

Alerta de ciberseguridad en los móviles Android: un virus ha infectado 2,3 millones de móviles y está robando datos de WhatsApp

Un malware para Android llamado NoVoice se ha distribuido a través de más de 50 apps que,…..

Alerta crítica de seguridad en iPhone: Apple confirma los ataques a estas versiones de iOS y la solución es más sencilla de lo que parece

Puede que te haya saltado en la pantalla un aviso que suena serio. «Software crítico» no es…..

Es oficial: Google escucha todas tus conversaciones y esto es lo que tienes que hacer para proteger tu privacidad

La IA de Meta engaña a un empleado y activa un peligrosa alerta de seguridad que pudo acabar con una empresa

Todos usamos los códigos QR en los bares pero un experto en ciberseguridad alerta: «Una puerta de entrada»

Instan a desinstalar WhatsApp y Gmail del móvil: los expertos en ciberseguridad preocupados por los graves riesgos

Dispositivos

WhatsApp va a dejar de funcionar en 15 millones de móviles muy pronto: la lista de los dispositivos afectados

Ni Oppo ni Samsung: el móvil que llevan los astronautas de Artemis II para hacer fotos desde el espacio

Los auriculares Bluetooth tienen los días contados y su sustituto es mucho mejor: con circuito de transmisión Wi-Fi integrado

Comunicado de Movistar Plus+ a todos sus clientes: los descodificadores HD ya tienen fecha de retirada y es muy pronto

Militar

Estados Unidos despliega un portaaviones de propulsión nuclear de 97.000 toneladas que se dirige a Sudamérica

El portaaviones nuclear USS Nimitz, el más veterano en servicio activo de la Marina de…..

Reino Unido acelera su arma láser naval: con cargador infinito para derribar drones sin límite de munición

El Gobierno británico ha confirmado que el arma láser DragonFire empezará a instalarse en los…..

Giro inaudito en España: la Armada va a construir un portaaviones inspirado en el Charles De Gaulle con capacidad para 30 aviones

España podría dar un salto importante en aviación embarcada. La Armada ha encargado a Navantia…..

Los nacidos entre 1981 y 2009 tendrán que pedir permiso al Ejército para salir del país: el Gobierno de Alemania lo hace oficial

Desde el 1 de enero de 2026, una reforma del servicio militar en Alemania ha…..

España da un giro en Defensa y el Gobierno lo confirma: incorporan aviones Airbus A400M para reforzar la flota

Mover ayuda o material militar a miles de kilómetros no es como pedir algo por…..

Estados Unidos desafía las leyes de la ingeniería con el avión ‘Batman’ que alcanza velocidades nunca vistas gracias a los motores turbofán

A primera vista parece el avión de un videojuego. Un ala enorme, una silueta de…..

Informática

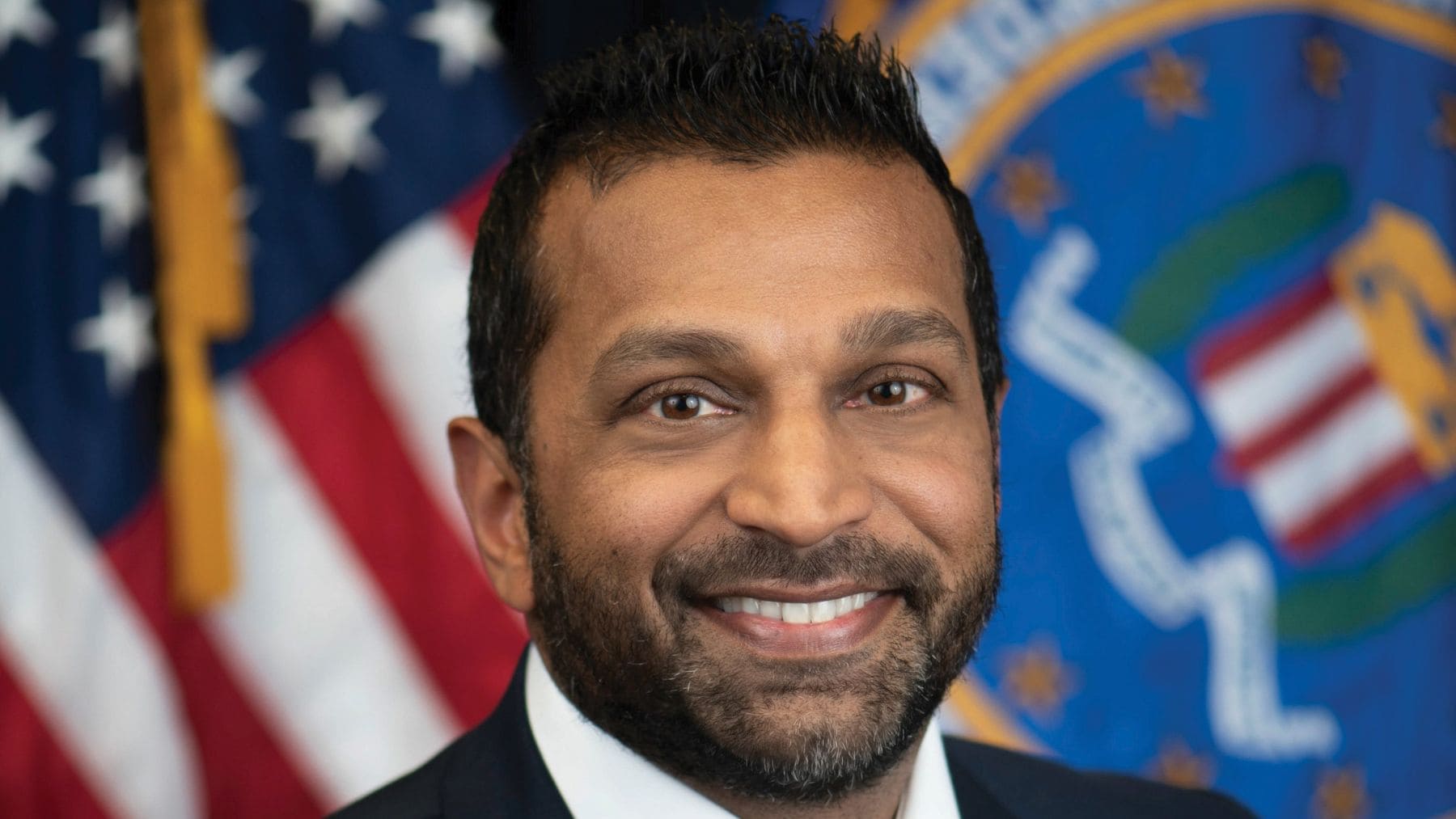

Mientras la IA no para de eliminar puestos de trabajos, esta profesión cada vez tiene más demanda: sueldos de 75.000 dólares e incorporación inmediata

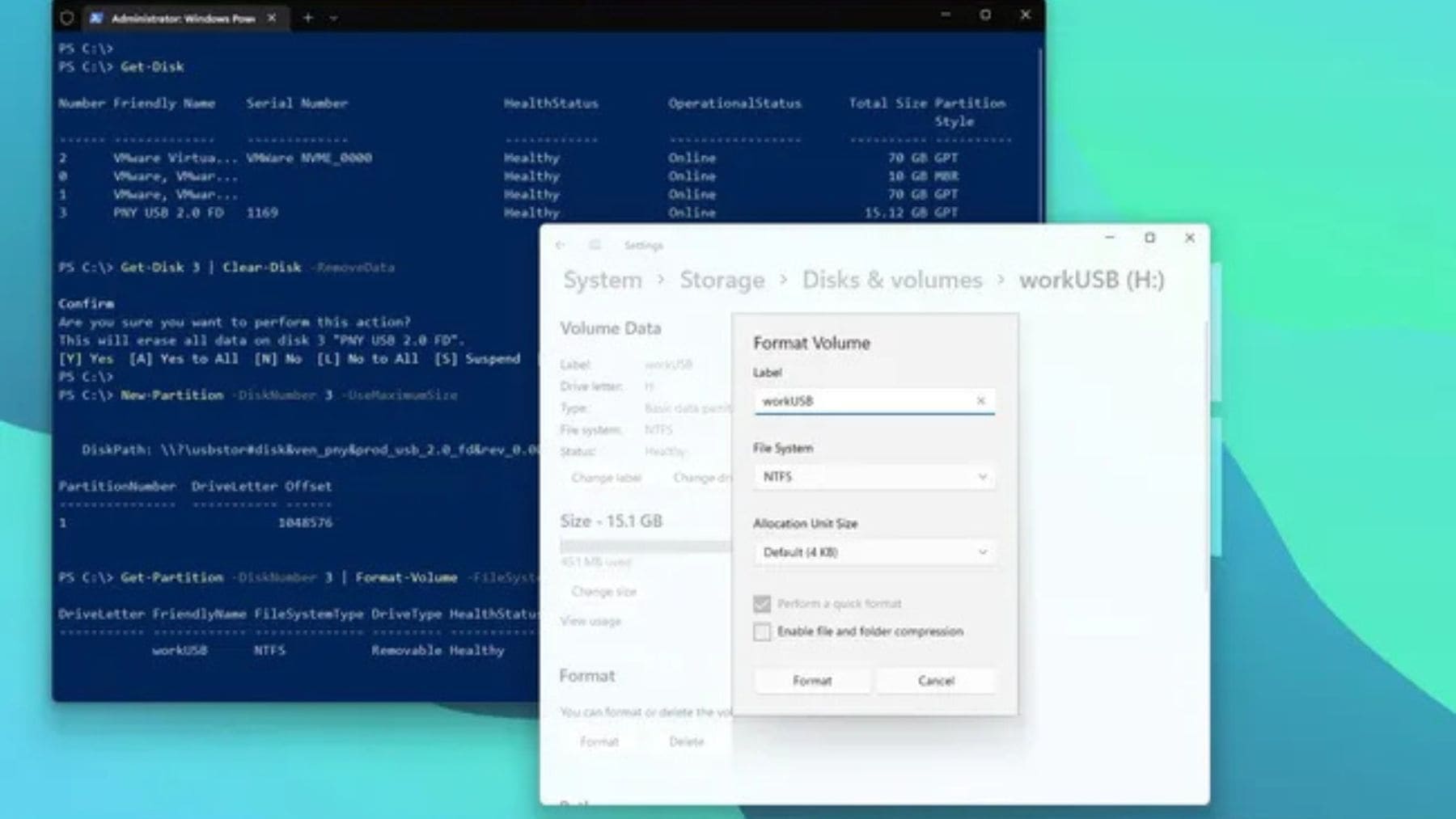

Tus vecinos se podrían estar conectando a tu WiFi pero hay una forma de saberlo y lo más importante, impedirlo

En 1994 un programador creó una interfaz «temporal» para Windows pero han pasado más de 30 años y fue tan brillante que la seguimos usando

Si tu televisor tiene un puerto HDMI tienes un tesoro pero el problema es que no sabes configurarlo y estos son las 3 funciones que debes cambiar

Los expertos piden que apagues el router unos minutos todos los días y ésta es la razón: el simple gesto que te cambia la vida

Inteligencia Artificial

Parece ciencia ficción pero la IA puede leer la mente: expertos logran que un paciente con ELA recupere la voz

¿Te imaginas perder la voz de un día para otro? No poder pedir agua, mandar una nota…..

«No confíe en Copilot»: Microsoft manda un aviso a los usuarios sobre su IA y es importante

Copilot, el asistente de inteligencia artificial de Microsoft, ya no es una curiosidad para “probar un rato”……

Google desafía a ChatGPT y Claude con su nuevo conjunto de modelos de IA: por qué ahora vas a usar Gemma 4

Por primera vez en la historia ChatGPT ha resuelto un problema matemático sin solución: los científicos no dan crédito

Un estudio confirma que las personas que llevan meses utilizando la IA tienen este rasgo común: son «neurodivergentes»

5 carreras universitarias que jamás deberías estudiar: no vas a encontrar trabajo y la IA lo avala

Juegos

Pokémon celebra su 30 aniversario con ‘Pokémon Champions’, el nuevo juego gratuito para Nintendo Switch

Nueva filtración sobre la PS6: se descubre lo que Sony no quiere que sepan sus competidores y en Xbox ya están temblando

Un ex trabajador de Nintendo confirma la peor noticia sobre la Switch 2 y avisa: «Inevitable»

Sólo cuesta 25 euros pero ha superado a Resident Evil Requiem en la tienda de Steam en marzo: es el mejor juego de cartas

El verdadero significado de los agujeros que hay en la parte trasera de los mandos de la PS5 y para qué sirven

Techy44 USA · Latest

Ver Sección

Techy44 USA · Latest

Ver Sección

| Últimas Noticias | Fecha |

|---|---|

| Loading… | |